Jörg Wettlaufer / DALL-E 2024

Jörg Wettlaufer / DALL-E 2024

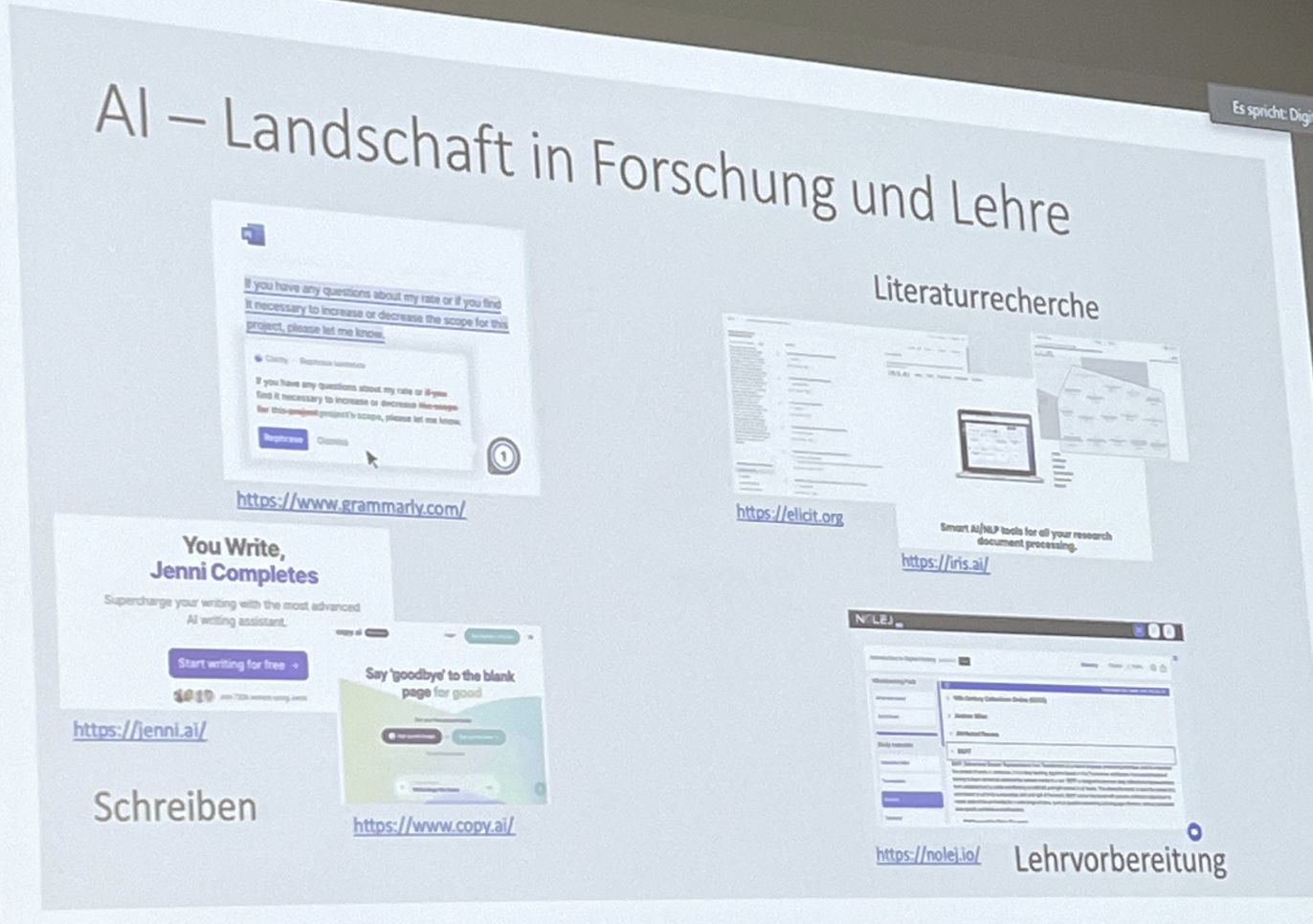

Um Methoden aus dem Bereich der Künstlichen Intelligenz adäquat in der Forschung anwenden zu können, ist es erforderlich, sie in ihren Grundzügen zu verstehen und idealerweise aktiv (spielerisch) zu erproben.

- Welche Verfahren gibt es überhaupt und wie funktionieren sie technisch?

- Wo kommen sie im Akademienprogramm bereits zum Einsatz, wie können Forschende voneinander lernen und Synergien nutzen?

- Profitieren die Geisteswissenschaften nur von den neueren Entwicklungen im Bereich Generativer KI oder leisten sie auch einen Beitrag zur KI-Entwicklung?

Die Themenkonferenz, die von der Akademie der Wissenschaften in Hamburg und der Niedersächsische Akademie der Wissenschaften zu Göttingen ausgerichtet wird, möchte sich diesem Spannungsfeld widmen. Teilnehmende aus den Akademievorhaben haben die Möglichkeit, die Potenziale neuer Methoden für die Analyse und Aufbereitung digitaler Ressourcen, speziell im Akademienprogramm, gemeinsam zu erörtern und zu erproben.

Das jeweils aktuelle Programm ist unter diesem Link verfügbar.

Vorläufiges Programm (Stand 20. August 2024):

Montag, 23. September 2024

ab 12:00 Ankunft der Teilnehmenden

12:45 Begrüßung

Workshop

13:00 – 17:00 Jan Kamlah, Thomas Schmidt (Mannheim)

eScriptorium

18:00 Öffentlicher Abendvortrag (Link)

Prof. Dr. Chris Biemann (Hamburg)

Where do you come from, ChatGPT? – Funktionsweise von Sprachmodellen

Dienstag, 24. September 2024

9:00 – 10:30 Integration von KI in Akademievorhaben: Projekte und Perspektiven

Matteo Burioni, Peter Bell (München)

Geplante KI-Anwendungen im Korpus der barocken Deckenmalerei

Wolfram Enßlin, Nathanael Philipp & Nadine Quenouille (Leipzig)

Forschungsportal BACH – Möglichkeiten der Integration von KI-gestützten Methoden

Jonatan Jalle Steller, Dominik Kasper (Mainz)

KI × DH: Zum Umgang mit ML, Transformern und LLMs in der Digitalen Akademie

10:30 – 11:00 Kaffeepause

11:00 – 12:30 OCR, HTR, Editionen und Urkunden

Daniel Kinitz (Leipzig)

ML-basierte Texterkennung arabographischer Handschriftenkataloge – Herausforderungen und Best Practices

Frederik Skidzun (Berlin)

Automatisierte Übersetzung von Urkundenregesten mit DeepL

Jörg Wettlaufer (Göttingen)

Custom-GPTs für die Entitäten-Erkennung und Auszeichnung

12:30 – 14:00 Mittagspause

14:00 – 15:30 Lexika, Übersetzungen und Annotation

Jan Christian Schaffert (Göttingen)

Edition, KI und Lexikographie – Wie können digitale und interdisziplinäre Zugänge zu der frühneuhochdeutschen Textwelt geschaffen werden?

Manuel Raaf (München)

Die Lemmatisierung von Zettelkästen mittels Deep Learning: Handschriftenerkennung im Fränkischen Wörterbuch

Patrick D. Brookshire (Mainz)

Namen erkennen und klassifizieren. Fine-Tuning von Transformer-Modellen

15:30 – 16:00 Kaffeepause

16:00 – 17:30 Retrieval Augmented Generation und Linked Open Data

Bärbel Kröger, Kaan Bashar (Göttingen)

Informationsextraktion aus lateinischen Texten des Repertorium Germanicum mittels Custom GPTs

Thomas Eckart, Felix Helfer, Uwe Kretschmer (Leipzig)

Machine-learning gestütztes Entity Linking

Timm Lehmberg, Stefano Valente (Hamburg)

Anwendungsbeispiel für dokumentbasiertes Parsing

19:30 Angebot einer Lichterfahrt auf der Elbe (Selbstzahler)

Mittwoch, 25. September 2024

Hands-On-Sessions

9:00 – 13:00 Timm Lehmberg (Hamburg)

Hackathon “Chat mit RAGgate”. Eigene Datenbasen mithilfe von Retrieval Augmented Generation zugänglich machen

9:00 – 13:00 Ines Röhrer (München)

Prompt-a-thon “Mein Bot versteht mich nicht!” Verarbeitung von Prompts verstehen und bessere Ergebnisse erzielen

Die Anmeldung ist für MitarbeiterInnen der Vorhaben aus dem Akademienprogramm und Akademiemitglieder online bis zum 31. August 2024 möglich unter: https://form.adwhh.de/index.php/898549?lang=de

(Vor der Anmeldung erfolgt eine Registrierung und Prüfung Ihrer E-Mail-Adresse)

Fragen zu Inhalt und Programm der Konferenz können an ki@akademie-der-wissenschaften-in-hamburg.de oder direkt an Timm Lehmberg (timm.lehmberg@awhamburg.de) gerichtet werden.

Jörg Wettlaufer / DALL-E 2024

Jörg Wettlaufer / DALL-E 2024